ę¶Ēæ┘YėŹ

ūŅą┬ūŅ╚½ūŅ£╩┤_Ą─ę¶ĒæąąśIą┼Žó

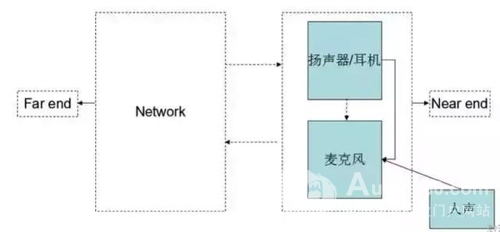

į┌ęĢŅl╗“š▀ę¶Ņl═©įÆ▀^│╠ųąŻ¼ę╗ĘĮ├µ×ķ┴╦£pąĪįŁ╩╝┬Ģę¶öĄō■Ą─é„▌ö┤a┬╩Ż¼ąĶę¬▀Mąąę¶Ņlē║┐sŻ¼┴Ēę╗ĘĮ├µ×ķ┴╦Ą├ĄĮĖ³Ė▀┘|┴┐Ą─ę¶┘|Ż¼ąĶę¬▀Mąąę¶Ņl╠Ä└ĒĪŻ╚ń║╬╠Ä└Ē║├▀@ā╔ĘĮ├µŻ¼▒ŻūC┬Ģę¶é„▓źĄ─Ė▀šµąįŻ¼╩ŪéĆ╝╝ąg╗Ņā║ŻĪ

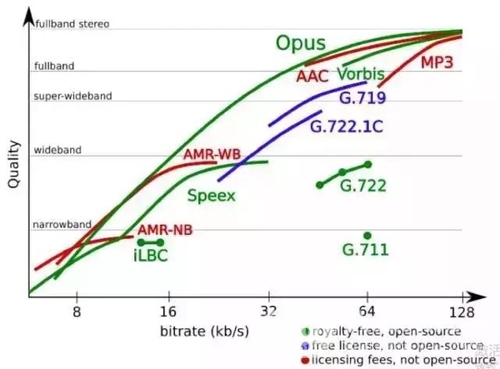

ę¶Ņl╠Ä└ĒĄ─ĘĮĘ©ų„ę¬░³└©Ż║ę¶ŅlĮĄįļĪóūįäėį÷ęµ┐žųŲĪó╗ž┬ĢęųųŲĪóņoę¶Öz£y║═╔·│╔╩µ▀mįļ┬ĢŻ¼ų„ꬥ─æ¬ė├ł÷Š░╩ŪęĢŅl╗“š▀ę¶Ņl═©įÆŅIė“ĪŻę¶Ņlē║┐s░³└©Ė„ĘNę¶ŅlŠÄ┤aś╦£╩Ż¼║Ł╔wITUųŲČ©Ą─ļŖą┼ŅIė“ę¶Ņlē║┐sś╦£╩Ż©G.7xxŽĄ┴ąŻ®║═╬ó▄øĪóGoogleĪó╠O╣¹ĪóČ┼▒╚Ą╚╣½╦ŠųŲČ©Ą─╗ź┬ōŠWŅIė“Ą─ę¶Ņlē║┐sś╦£╩ĪŻŻ©iLBCĪóSILKĪóOPUSĪóAACĪóAC3Ą╚Ż®ĪŻ

ĪĪĪĪę¶Ņl╗∙ĄAĖ┼─Ņ

ĪĪĪĪį┌▀Mę╗▓Į┴╦ĮŌę¶Ņl╠Ä└Ē║═ē║┐sų«Ū░ąĶę¬ų¬Ą└▀@ą®Ż║

ĪĪĪĪŻ©1Ż®ę¶š{Ż║Ę║ųĖ┬Ģ궥─Ņl┬╩ą┼ŽóŻ¼╚╦Č·Ą─ų„ė^Ėą╩▄×ķ┬Ģ궥─Ą═│┴Ż©Ą═궯®╗“š▀╝ŌõJŻ©Ė▀궯®ĪŻ

ĪĪĪĪŻ©2Ż®ĒæČ╚Ż║┬Ģ궥─ÅŖ╚§ĪŻ

ĪĪĪĪŻ©3Ż®▓╔śė┬╩Ż║┬Ģ궹┼Žóį┌ė╔─ŻöMą┼╠¢▐D╗»×ķöĄūųą┼╠¢▀^│╠ųąĄ─Š½┤_│╠Č╚Ż¼▓╔śė┬╩įĮĖ▀Ż¼┬Ģ궹┼Žó▒Ż┴¶Ą─įĮČÓĪŻ

ĪĪĪĪŻ©4Ż®▓╔śėŠ½Č╚Ż║┬Ģ궹┼Žóį┌ė╔─ŻöMą┼╠¢▐D╗»×ķöĄūųą┼╠¢▀^│╠ųąŻ¼▒Ē╩Š├┐ę╗éĆ▓╔śė³c╦∙ąĶꬥ─ūų╣ØöĄŻ¼ę╗░Ń×ķ16bitŻ©ļpūų╣ØŻ®▒Ē╩Šę╗éĆ▓╔śė³cĪŻ

ĪĪĪĪŻ©5Ż®┬ĢĄ└öĄŻ║ŽÓĻPĄ─Äū┬Ę┬Ģę¶öĄ┴┐Ż¼│ŻęŖĄ─╚ńå╬┬ĢĄ└Īóļp┬ĢĄ└Īó5.1┬ĢĄ└ĪŻ

ĪĪĪĪŻ©6Ż®ę¶ŅlļķLŻ║ę¶Ņl╠Ä└Ē╗“š▀ē║┐s╦∙▓┘ū„Ą─ę╗Č╬ę¶Ņlą┼ŽóŻ¼│ŻęŖĄ─╩Ū10msŻ¼20msŻ¼30msĪŻ

ĪĪĪĪę¶Ņl╠Ä└Ē╗∙ĄA

ĪĪĪĪ1 įļ┬ĢęųųŲŻ©Noise SuppressionŻ®

ĪĪĪĪ╩ųÖCĄ╚įOéõ▓╔╝»Ą─įŁ╩╝┬Ģę¶═∙═∙░³║¼┴╦▒│Š░įļ┬ĢŻ¼ė░Ēæ┬Ā▒ŖĄ─ų„ė^¾w“ׯ¼ĮĄĄ═ę¶Ņlē║┐są¦┬╩ĪŻęįGoogleų°├¹Ą─ķ_į┤┐“╝▄WebRTC×ķ└²Ż¼╬ęéāī”ŲõųąĄ─įļ┬ĢęųųŲ╦ŃĘ©▀Mąąć└ųöĄ─£yįćŻ¼░l¼Fįō╦ŃĘ©┐╔ęįī”░ūįļ┬Ģ║═ėą╔½įļ┬Ģ▀Mąą┴╝║├Ą─ęųųŲĪŻØMūŃęĢŅl╗“š▀šZę¶═©įÆĄ─ę¬Ū¾ĪŻ

ĪĪĪĪŲõ╦¹│ŻęŖĄ─įļ┬ĢęųųŲ╦ŃĘ©╚ńķ_į┤ĒŚ─┐Speex░³║¼Ą─įļ┬ĢęųųŲ╦ŃĘ©Ż¼ę▓ėą▌^║├Ą─ą¦╣¹Ż¼įō╦ŃĘ©▀mė├ĘČć·▌^WebRTCĄ─įļ┬ĢęųųŲ╦ŃĘ©Ė³╝ėÅVĘ║Ż¼┐╔ęįį┌╚╬ęŌ▓╔śė┬╩Ž┬╩╣ė├ĪŻ

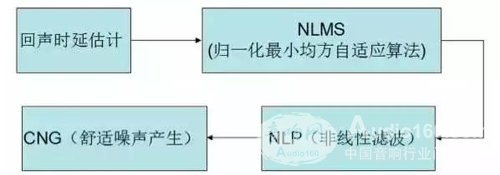

ĪĪĪĪ2 ╗ž┬ĢŽ¹│²Ż©Acoustic EchoCancellerŻ®

ĪĪĪĪį┌ęĢŅl╗“š▀ę¶Ņl═©įÆ▀^│╠ųąŻ¼▒ŠĄžĄ─┬Ģę¶é„▌öĄĮī”Č╦▓źĘ┼ų«║¾Ż¼┬Ģę¶Ģ■▒╗ī”Č╦Ą─¹£┐╦’L▓╔╝»Ż¼╗ņ║Žų°ī”Č╦╚╦┬Ģę╗Ųé„▌öĄĮ▒ŠĄž▓źĘ┼Ż¼▀@śė▒ŠĄž▓źĘ┼Ą─┬Ģę¶░³║¼┴╦▒ŠĄžįŁüĒ▓╔╝»Ą─┬Ģ궯¼įņ│╔ų„ė^ĖąėX┬ĀĄĮ┴╦ūį╝║Ą─╗ž┬ĢĪŻ

ĪĪĪĪ╗ž┬Ģ«a╔·Ą─įŁ└Ē╚ńŽ┬łD╦∙╩ŠŻ║

ĪĪĪĪęįWebRTC×ķ└²Ż¼ŲõųąĄ─╗ž┬ĢęųųŲ─ŻēKĮ©ūhęŲäėįOéõ▓╔ė├▀\╦Ń┴┐▌^ąĪĄ─AECM╦ŃĘ©Ż¼įō╦ŃĘ©Ą─╠Ä└Ē▓Į¾E╚ńŽ┬łD╦∙╩ŠĪŻėą┼d╚żĄ─ūxš▀┐╔ęįģó┐╝AECMĄ─į┤┤·┤a▀MąąčąŠ┐Ż¼▀@└’▓╗š╣ķ_ĮķĮB┴╦ĪŻ

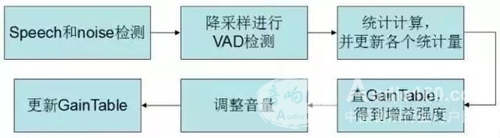

ĪĪĪĪ3 ūįäėį÷ęµ┐žųŲŻ©Auto Gain ControlŻ®

ĪĪĪĪ╩ųÖCĄ╚įOéõ▓╔╝»Ą─ę¶ŅlöĄō■═∙═∙ėąĢr║“ĒæČ╚Ų½Ė▀Ż¼ėąĢr║“ĒæČ╚Ų½Ą═Ż¼įņ│╔┬Ģę¶║÷┤¾║÷ąĪŻ¼ė░Ēæ┬Ā▒ŖĄ─ų„ė^Ėą╩▄ĪŻūįäėį÷ęµ┐žųŲ╦ŃĘ©Ė∙ō■ŅAŽ╚┼õų├Ą─ģóöĄī”▌ö╚ļ┬Ģę¶▀Mąąš²Ž“/žōŽ“š{╣ØŻ¼╩╣Ą├▌ö│÷Ą─┬Ģę¶▀mę╦╚╦Č·Ą─ų„ė^Ėą╩▄ĪŻ

ĪĪĪĪęįWebRTC×ķ└²Ż¼╦³Ą─ūįäėį÷ęµ┐žųŲ╦ŃĘ©Ą─╗∙▒Š┴„│╠łD╚ńŽ┬╦∙╩ŠĪŻ

ĪĪĪĪ4 ņoę¶Öz£yŻ©Voice ActivityDetectionŻ®

ĪĪĪĪņoę¶Öz£yĄ─╗∙▒ŠįŁ└ĒŻ║ėŗ╦Ńę¶ŅlĄ─╣”┬╩ūV├▄Č╚Ż¼╚ń╣¹╣”┬╩ūV├▄Č╚ąĪė┌ķōųĄätšJ×ķ╩Ūņo궯¼Ę±ätšJ×ķ╩Ū┬Ģę¶ĪŻņoę¶Öz£yÅVĘ║æ¬ė├ė┌ę¶ŅlŠÄ┤aĪóAGCĪóAECMĄ╚ĪŻ

ĪĪĪĪ5 ╩µ▀mįļ┬Ģ«a╔·Ż©ComfortableNoiseGenerationŻ®

ĪĪĪĪ╩µ▀mįļ┬Ģ«a╔·Ą─╗∙▒ŠįŁ└ĒŻ║Ė∙ō■įļ┬ĢĄ─╣”┬╩ūV├▄Č╚Ż¼╚╦×ķśŗįņįļ┬ĢĪŻÅVĘ║▀mė├ė┌ę¶ŅlŠÄĮŌ┤aŲ„ĪŻį┌ŠÄ┤aČ╦ėŗ╦Ńņoę¶ĢrĄ─░ūįļ┬Ģ╣”┬╩ūV├▄Č╚Ż¼īóņoę¶ĢrČ╬║═╣”┬╩ūV├▄Č╚ą┼ŽóŠÄ┤aĪŻį┌ĮŌ┤aČ╦Ż¼Ė∙ō■Ģrķgą┼Žó║═╣”┬╩ūV├▄Č╚ą┼ŽóŻ¼ųžĮ©ļSÖC░ūįļ┬ĢĪŻ

ĪĪĪĪ╦³Ą─æ¬ė├ł÷Š░Ż║═Ļ╚½ņoę¶ĢrŻ¼×ķ┴╦äōįņ╩µ▀mĄ─═©įƾw“ׯ¼į┌ę¶Ņl║¾╠Ä└ĒļAČ╬╠Ē╝ėļSÖC░ūįļ┬ĢĪŻ

ĪĪĪĪę¶ŅlŠÄ┤a╗∙ĄA

ĪĪĪĪę¶ŅlĄ─┴Ēę╗éĆÅVĘ║æ¬ė├Ą─ŅIė“Ż║ę¶ŅlŠÄ┤aĪŻ

ĪĪĪĪ╩ūŽ╚┐┤ę╗Ž┬«öŪ░æ¬ė├ūŅÅVĘ║Ą─ę╗ą®ę¶ŅlŠÄ┤aś╦£╩Ż¼╚ńŽ┬łD╦∙╩ŠĪŻ

ĪĪĪĪłDųąÖM▌S╩Ūę¶ŅlŠÄ┤a┤a┬╩Ż¼┐v▌S╩Ūę¶ŅlŅlĦą┼ŽóĪŻÅ─łDųą╬ęéā┐╔ęį½@Ą├╚ńŽ┬ÄūĘĮ├µą┼ŽóĪŻ

ĪĪĪĪŻ©1Ż®ī”ė┌╣╠Č©┤a┬╩Ą─ŠÄ┤aś╦£╩Ż¼╚ńG.711╗“š▀G.722Ż¼łDųą▓╔ė├å╬³c▒Ē╩ŠŻ¼šf├„▀@ā╔éĆŠÄ┤aś╦£╩╩Ū╣╠Č©┤a┬╩ŠÄ┤aś╦£╩ĪŻŲõ╦¹╚ńOpusĪóSpeexŻ¼╦³éāĄ─Ū·ŠĆ╩Ū▀B└mĄ─Ż¼šf├„▀@ŅÉŠÄ┤aś╦£╩╩Ū┐╔ūā┤a┬╩Ą─ŠÄ┤aś╦£╩ĪŻ

ĪĪĪĪŻ©2Ż®Å─ŅlĦĘĮ├µ┐┤Ż¼G.711ĪóG.722ĪóAMR║═iLBCĄ╚ś╦£╩▀mė├ė┌narrowbandŻ©8khz▓╔śė┬╩Ż®║═widebandŻ©16khz▓╔śė┬╩Ż®ĘČć·Ż¼ßśī”Ųš═©Ą─šZę¶═©įÆł÷Š░ĪŻAAC║═MP3▀mė├ė┌fullbandŻ©48khz▓╔śė┬╩Ż®ĘČć·Ż¼ßśī”╠ž╩ŌĄ─궜ʳ÷Š░ĪŻČ°Opus▀mė├ė┌š¹éĆŅlĦŻ¼┐╔ęį▀MąąūŅ┤¾ĘČć·Ą─äėæBš{╣ØŻ¼▀mė├ĘČć·ūŅÅVĪŻ

ĪĪĪĪŻ©3Ż®Å─ś╦£╩Ą─╩š┘MŪķør┐┤Ż¼▀mė├ė┌╗ź┬ōŠWé„▌öĄ─iLBCĪóSpeex║═OpusČ╝╩Ū├Ō┘MŪęķ_į┤Ą─Ż╗▀mė├ė┌궜ʳ÷Š░Ą─MP3║═AACŻ¼ąĶę¬license╩┌ÖÓŻ¼Č°Ūę▓╗ķ_į┤ĪŻ

|